9.2.4 在线社交网络跨媒体对抗学习

在线社交网络跨媒体对抗学习用于学习图像模态和文本模态之间的语义关联关系以保存两个模态间的相似性,通过生成过程和判别过程之间的相互对抗,获取到跨媒体特征的公共语义表示。

1.在线社交网络跨媒体生成过程

如图9-1所示,在社交网络跨媒体对抗学习过程中,通过在线社交网络跨媒体数据的对抗学习过程中的生成过程产生具有一致性的跨媒体公共语义表示。生成过程通过带参数的三层前馈神经网络实现,构建了模态内语义一致性约束、模态间语义一致性约束及语义相关性损失函数。通过综合语义一致性约束及语义相关损失函数,学习跨媒体的公共语义表示。语义一致性约束分别从模态内和模态间的视角进行构建,语义相关性损失通过交叉熵损失函数来构建。

在跨媒体搜索中,跨媒体数据在模态内和模态间的语义上是相关的。在不同模态间,来自不同模态的具有相同标签或者语义类别的数据所描述的语义是一致的。在生成过程中,通过利用语义一致性约束来获取较为一致的语义表示。给定映射后的图像特征 和文本特征

和文本特征 ,计算其对应的分类中心z i和z t,计算公式如式(9-1)和式(9-2)所示:

,计算其对应的分类中心z i和z t,计算公式如式(9-1)和式(9-2)所示:

在模态内,具有相同类别的同模态数据的距离保持最小化,计算方法如式(9-3)所示:

跨媒体数据中的具有相同类别的不同模态之间的类别中心保持最小化,计算方法如式(9-4)所示:

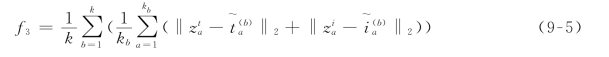

类中心与来自具有相同语义类别的其他模态数据间的距离需要最小化,计算方法如式(9-5)所示:

综合式(9-3)~式(9-5)的模态内和模态间的语义约束,得到跨媒体数据的总体语义约束,如式(9-6)所示:

![]()

不同模态之间通过利用耦合度量学习方法定义语义相关性损失,以实现不同模态特征表示的类内差异最小和类间差异最大。对于来自两种不同模态的每对训练样本ia和t a,根据式(9-7)计算模态间的平方距离:

![]()

如果ia和t a属于同一类,则希望d(i a,t a)尽可能小,否则需要尽可能大。可以表述为以下约束条件:如果l ia,ta=1,即ia和t a属于相同的类,则d(ia,t a)≤η1;相反,如果l ia,ta=-1,即ia和t a属于不同的类,则d(ia,ta)≥η2,其中,η1和η2分别表示阈值的上下限。可以构建式(9-8)来优化目标:

![]()

其中,s(·)表示生成的逻辑损失函数,η1=η-1,η2=η+1。第二项最小化了从不同模态数据捕获的同一类别的每对数据之间的差异。

在社交网络跨媒体对抗学习中,虽然获取的特征具有相同的维度,但由于变换后的特征的统计特性仍然未知,因此不能保证它们是直接可比的。为了使两个不同模态的特征可以比较,并保证公共语义映射后数据中的模态判别信息被保留,需要从训练样本中挖掘出更具判别性的信息。我们采用分类器对生成过程中公共语义表示的语义标签进行判别。在每个子空间嵌入神经网络中添加了由softmax激活的前馈网络。该分类器将图像和文本对实例的特征表示作为训练数据,输出模态的语义类别概率分布。假设ca是语义表示的真实标签。P a表示从标签分类器输出预测的概率分布。跨媒体数据特征判别损失的计算如式(9-9)所示:

![]()

2.在线社交网络跨媒体判别过程

为了强化语义特征的统计信息,引入参数为θd的模态分类器D作为对抗学习的判别过程参数,对生成过程生成的公共语义表示进行分类信息的判断和区分。对于判别过程中的模态分类器,其目标是在给定未知映射特征的情况下尽可能精确地区分源模态。在判别过程中,利用参数为θd的三层前馈神经网络来实现模态分类器。对抗损失L adv的定义如式(9-10)所示:

![]()

其中,L adv表示模态分类的交叉熵损失,n表示迭代训练中跨媒体数据实例数,g i是每个实例的真实模态标签。

3.在线社交网络跨媒体对抗学习过程

为了充分地学习和保留两种模态的语义关联信息,基于式(9-5)~式(9-8),得到完整的损失函数,如式(9-11)所示:

![]()

其中,κ、μ和ν用于平衡损失函数中不同子项所占比例的正则化参数。

生成过程通过特征映射有效地学习跨媒体数据的公共语义表示,并为数据分配类别信息。判别过程通过模态分类器判别源模态信息,通过在对抗学习框架训练的公共特征映射和模态分类,提高公共语义表示的质量。跨媒体对抗学习过程分别如式(9-12)和式(9-13)所示:

其中, 表示参数值是定值。式(9-12)和式(9-13)的两个函数的优化目标是相反的,通过随机梯度下降进行优化,实现在线社交网络跨媒体对抗学习。

表示参数值是定值。式(9-12)和式(9-13)的两个函数的优化目标是相反的,通过随机梯度下降进行优化,实现在线社交网络跨媒体对抗学习。

通过在线社交网络跨媒体对抗学习的生成过程和判别过程的极大极小化对抗学习过程,可以不断改进公共语义映射的质量,当两个过程达到平衡后可以获得最佳性能。通过引入对抗学习过程,有效解决在线社交网络跨媒体信息的语义鸿沟问题,并获取到高质量的公共语义表示结果。