11.3.1 实验设置

1.数据集

在线社交网络跨媒体事件数据集:社交网络跨媒体数据集具有独特的特性。首先,其文本趋于口语化且通常较短,具有较强的语义稀疏性,且其图像质量往往不高。除文本和图像信息外,该数据中还包含了时空信息和用户信息等。本章在新浪微博中采集了“昆明暴恐”“滨海新区爆炸”“北京雾霾”“毒疫苗”“湖北暴雨”“八达岭老虎伤人”“饿了么黑心作坊”“上海外滩踩踏”“天津调料造假”和“长江客船翻沉”10个安全事件相关的社交网络跨媒体事件数据,共约20万条的新浪微博。该数据集中包含了微博的所有字段(文本、图像、时间、用户以及用户的注册地等)。为了获取高质量的文本图像对,对每个事件筛选了100张图像,并为每张图像挑选了相关的3~5条微博文本作为描述信息,最终从20万条微博数据集中构造了1 000个社交网络文本图像对。采用自动标注工具将其制作成与公共数据集格式一致的数据集。实验过程中,在每个类别中随机选择80对进行训练,其余数据作为测试集。

2.实验设置

(1)数据预处理

对于上述数据集内的每个实例,提取其三种特征:文本特征,图像特征和目标特征。对于社交网络安全事件数据集中的短文本信息,采用我们提出的在线社交网络多特征概率图模型(MFPGM)获取改善了语义稀疏性和时空差异性的文本特征。对于Pascal Sentence数据集和MS-COCO数据集的文本特征,由于其没有时空特性,因此利用了Word2vec获取文本的200维嵌入向量。对于图像特征的提取,对上述三个数据集均采用VGGNet-19,并使用其最后一个池化层的输出作为原始的图像特征,设定尺寸为512×7×7。此外,为了获取注意力机制中的目标特征,利用SIN网络在每个实例的图像数据中进行抽取,并将目标特征的维度设置为256×2 048。

(2)网络设计

在线社交网络跨媒体事件GAN中包含一个生成模型和一个判别模型。在生成模型中,将图像特征和文本特征分别放入两个不同的全连接层内,将两种单一模态的特征统一到同一维度。构建双层前向神经网络,将两种模态特征映射到统一公共语义空间内。添加一个全连接层预测跨媒体数据的事件标签。对于判别模型,建立三层前向神经网络对事件标签进行真实标签与预测生成标签的有效区分。

3.评价指标

为了验证本章提出的基于语义学习与时空特性的在线社交网络跨媒体事件搜索算法(CSES)的有效性,将搜索任务分为两种:模态内搜索任务和模态间搜索任务。两者的实现过程分别如下。

(1)模态内搜索

使用一种模态数据作为查询,并在测试集中搜索出相同的模态数据,使用文本搜索文本(表示为T-T),以及使用图像搜索图像(表示为I-I)。

(2)模态间搜索

使用一种模态数据作为查询并检索测试集中的另一类模态数据,使用文本搜索图像(表示为T-I),以及使用图像搜索文本(表示为I-T)。

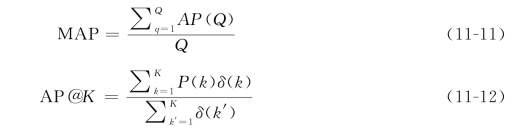

采用平均准确率(MAP)、精度范围曲线(precision-scope)和召回率(Recall@K)作为评价指标对本章提出的CSES算法与对比算法进行搜索性能的比较。如式(11-11)所示,MAP值表示所有查询平均准确率(AP)的均值,以及AP的取值:

其中Q表示搜索的数量,K为待搜索文档的数量,P(k)表示前k个搜索结果的精度。如果第k个搜索结果与查询相关,则δ(r)=1,否则δ(r)=0。MAP值越高意味着搜索性能越好。

4.对比算法

为了验证基于语义学习与时空特性的在线社交网络跨媒体事件搜索算法(CSES)的有效性,在实验中选择了6种已有的跨媒体搜索算法。包括两种基于浅层表示的跨媒体搜索算法(CFA和MACC)和4种基于深度神经网络的跨媒体搜索算法(Bi-AE、Multi-DBN、ACMR和CM-GAN)。其中,ACMR和CM-GAN算法为基于GAN的跨媒体搜索算法。