12.2 改进的BP神经网络

2025年09月26日

12.2 改进的BP神经网络

在本章中对BP神经网络的改进,主要是通过假设动量因子和自适应学习速率改善BP网络自身收敛速度慢和易陷入局部极小问题,然后再利用粒子群对其改进的BP神经网络进行优化处理。采用附加动量主要是来调整其权值,利用该方法是因为它将误差关联到了梯度上,它是基于反向传播将调整后的所有权值与调整前的权值进行正比,同时利用反向传播来产生新的权值。改进后权值调整公式如下:

Δwij(n+1)=(1+nb)ηEixj+nbΔwij(n)(12-9)

Δcj(n+1)=(1-nb)ηEi+nbΔci(k)(12-10)式中,i表示隐层数;j表示隐层中包含的节点数;n表示网络中训练的次数;Δw代表权值的变化增量;η代表网络的学习速率;E表示网络的误差;nb为动量因子。

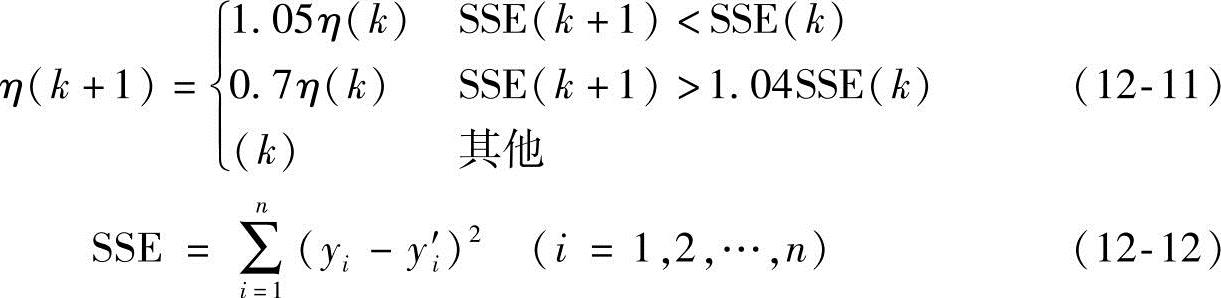

由上述对BP神经网络的分析和介绍可知,如何选择学习效率对训练的速度有很大的影响,所以在网络中通过添加自适应学习算法来自动调节学习效率,这样就能相应准确地选择学习效率,它主要是通过对修改后的权值进行检查,如果该权值降低了,网络中的误差就会相应地对其添加一个量,相反就会降低学习效率,该调整公式如下所示:

上述对BP神经网络本身进行改进,因为改进本身还存在一定的局限性,所以接下来还会利用粒子群优化算法对改进后的BP神经网络进一步进行优化,这样会使得该网络更不容易出现陷入局部极小或者收敛过慢等不稳定的情况。